DeepSeek推出了DeepSeek-V3,这是一个强大的混合专家(Mixture-of-Experts,MoE)语言模型,总参数量达到6710亿,每个标记(token)激活的参数量为370亿。

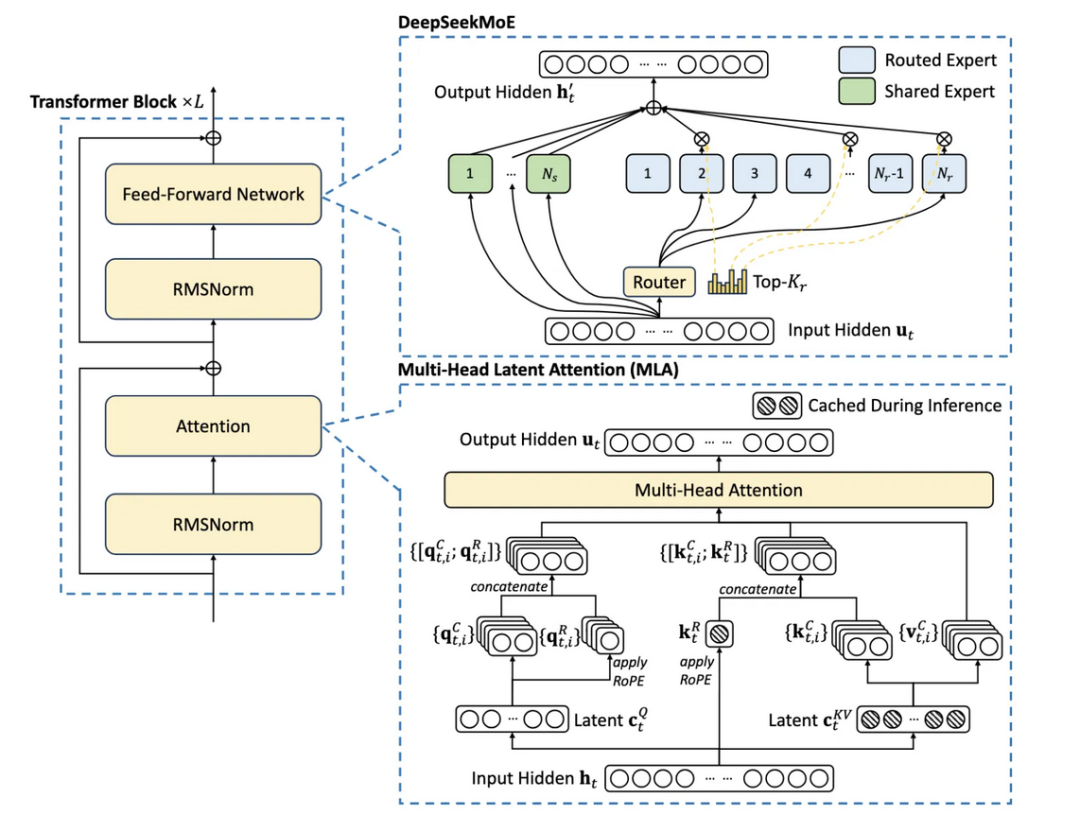

为了实现高效的推理和成本效益高的训练,DeepSeek-V3采用了在DeepSeek-V2中经过充分验证的多头潜在注意力(Multi-head Latent Attention,MLA)和DeepSeekMoE架构。

DeepSeek对DeepSeek-V3进行了预训练,使用的是14.8万亿个多样且高质量的标记,随后进行了监督微调(Supervised Fine-Tuning)和强化学习(Reinforcement Learning)阶段,以充分发挥其能力。

DeepSeek-V3以低成本(仅需278.8万H800 GPU小时)实现卓越训练稳定性,性能媲美领先闭源模型。

一、混合专家

二、DeepSeekMoE

-

专家混合系统(MoE)层:该层包含动态路由机制和专家共享机制。动态路由机制允许模型根据输入数据的特点选择性地激活部分专家,而不是一次性激活所有专家,从而提高计算效率。专家共享机制则通过在不同令牌或层间共享部分专家的参数,减少模型冗余并提升性能。

-

多头潜在注意力(Multi-Head Latent Attention, MLA)机制:MLA机制引入潜在向量用于缓存自回归推理过程中的中间计算结果,降低了生成任务中的浮点运算量。同时,MLA机制还通过预计算并复用静态键值来优化键值缓存,进一步提高了计算效率。

-

RMSNorm归一化:DeepSeekMoE采用RMSNorm替代传统LayerNorm,仅使用均方根统计进行输入缩放。这种简化设计不仅减少了计算量,还提升了训练稳定性。

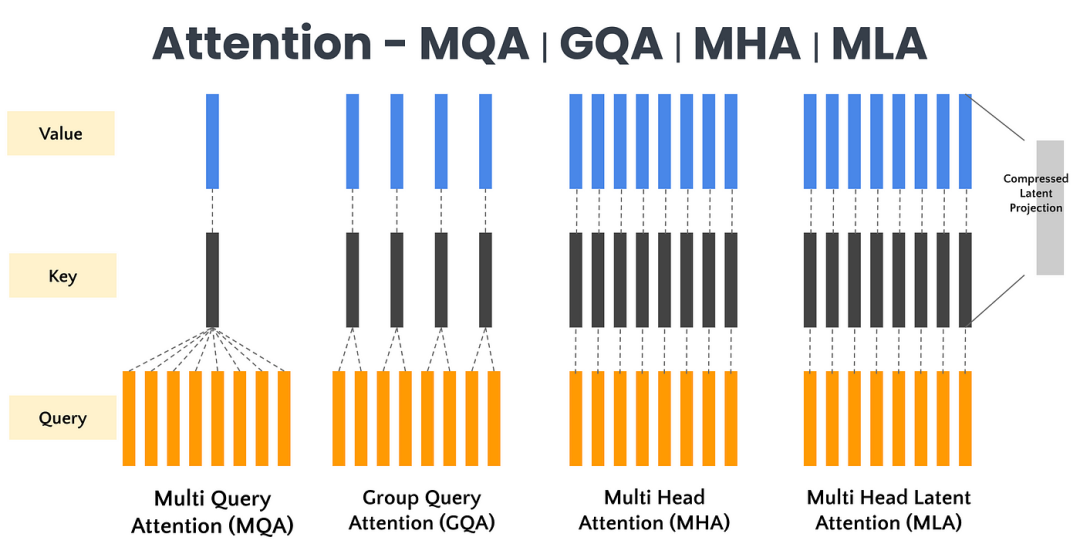

多头潜在注意力(MLA)和多头注意力(MHA)的区别是什么?MLA在计算注意力时,通过projection的方式获取多头的Key和Value,保留了多头的注意力计算方式。这使得MLA在降低计算和内存开销的同时,能够保持与MHA相当的模型性能。同时MLA通过合并权重矩阵,进一步减少了参数数量和计算量。

-

低秩联合压缩键值:MLA通过低秩联合压缩键值(Key-Value),将它们压缩为一个潜在向量(latent vector),从而大幅减少所需的缓存容量。这种方法不仅减少了缓存的数据量,还降低了计算复杂度。

-

优化键值缓存:在推理阶段,MHA需要缓存独立的键(Key)和值(Value)矩阵,这会增加内存和计算开销。而MLA通过低秩矩阵分解技术,显著减小了存储的KV(Key-Value)的维度,从而降低了内存占用。