01

引言

大语言模型(LLMs)的爆发式发展,让AI领域迎来历史性拐点。这类系统早已颠覆自然语言处理领域,但真正的颠覆性潜能,只有当它与"自主行动力"(Agency)——即自主推理、规划与执行能力——结合时才得以释放。这正是LLM Agents(大模型智能体)诞生的意义:它们不仅理解语言,更具备思考和行动能力,正彻底重构人类与AI的协作方式。

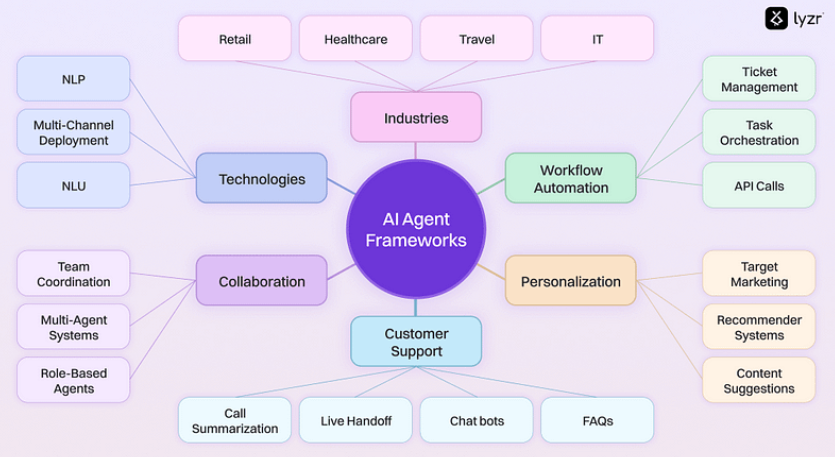

本文旨在全面概述AI Agents,深入探讨其特点、组成部分和类型,同时探讨其演变、挑战和潜在的未来方向。

02

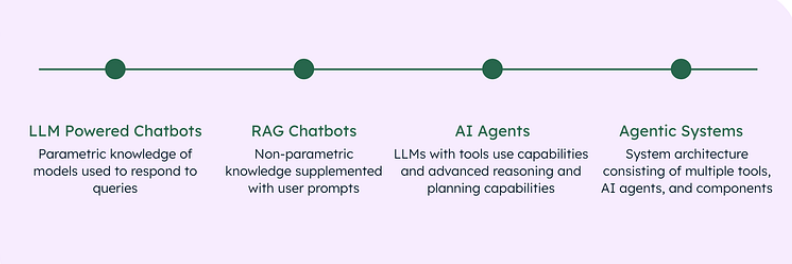

大语言模型应用的形态演变速度,堪称现代应用发展史上最迅猛的演进浪潮:

-

从传统聊天机器人到 LLM 驱动的聊天机器人

-

基于启发式的对话: 传统的聊天机器人采用基于规则的逻辑。仅限于预定义的规则,无法管理复杂或模糊的查询。 -

预定义的回复:答复是静态和预先确定的。一般通过检测特定关键词或短语触发。缺乏灵活性和对话深度。 -

人工接管机制: 一般通过设置“转接人工”按钮应对无法解决的咨询,在处理复杂问题时,人工干预仍然必不可少。

-

LLM 驱动的聊天机器人

2022年11月30日,OpenAI推出基于GPT-3.5的ChatGPT,标志着首个主流大语言模型(LLM)应用的诞生。它虽沿用了人们熟悉的聊天机器人界面,内核却是颠覆性的技术跃迁——依托先进的大语言模型技术,通过海量互联网语料训练,首次实现了接近人类思维水平的对话能力。

GPT(生成式预训练Transformer)的核心架构源于谷歌2017年提出的Transformer模型。其革命性在于引入自注意力机制——通过动态计算输入序列中每个词汇的关联权重,不仅能解析语句表层含义,更能捕捉深层次的上下文逻辑关系,彻底改变了传统NLP的范式。

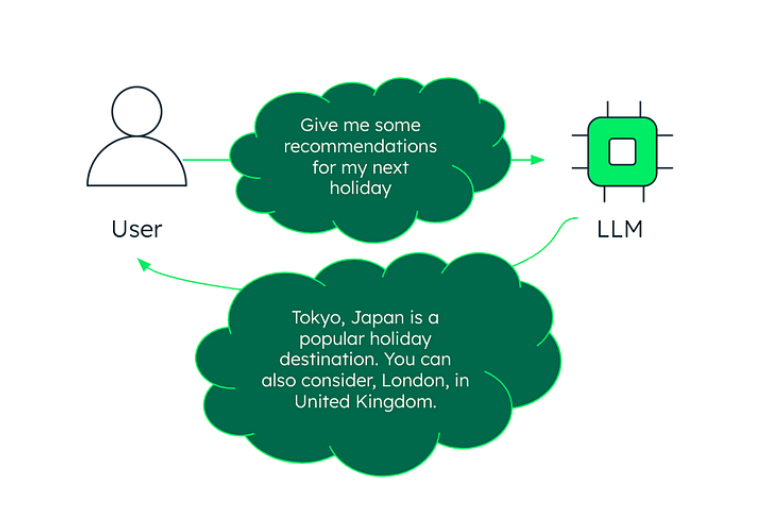

与传统聊天机器人不同,大语言模型的真正威力在于生成类人的、上下文连贯且富有创造性的文本。这种能力不仅体现在对话层面,更延展至代码生成(精准输出可执行代码)、内容创作(从营销文案到诗歌小说),以及客户服务升级(动态理解复杂需求)等场景,持续拓宽AI应用的新边界。

当然其局限性为:难以在长时间对话中保持一致的个性化互动。此外,LLM模型最受争议的缺陷,在于可能生成逻辑连贯但事实错误的回答(幻觉)——其输出依赖概率统计与模式拟合,而非基于已验证的知识体系。

-

从LLM 驱动的聊天机器人到RAG 聊天机器人和AI Agents

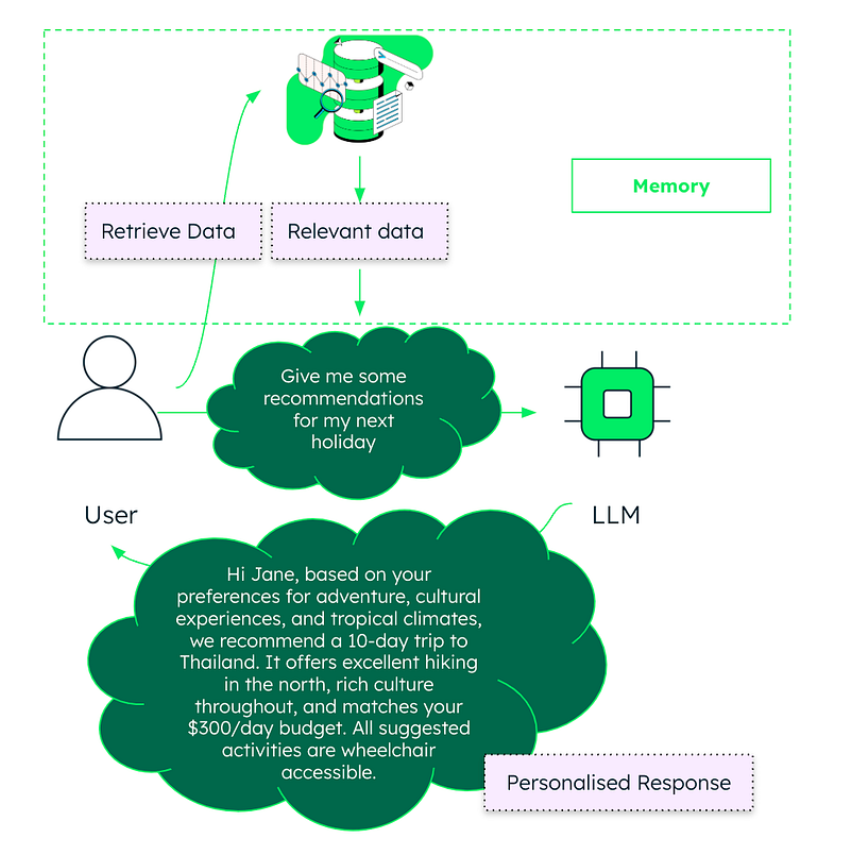

RAG(Retrieval-Augmented Generation,即检索增强生成)通过外部数据检索系统+大语言模型能力的深度融合,构建出新一代对话智能体。它能实时调用外部知识库(如企业文档、行业数据库),确保回答既具备LLM的创造力,又严格锚定真实场景,彻底解决“大模型幻觉”顽疾。

通过情境学习(In-Context Learning,如单样本/one-shot、少样本/few-shot)、思维链(Chain-of-Thought/CoT)及反应式推理(ReAct)等黑科技,工程师能像“AI驯兽师”般精准引导大模型的思维路径——不仅优化输出质量,更让模型展现出类人的分步推理能力,实现从“机械应答”到“逻辑推演”的进化跃迁。

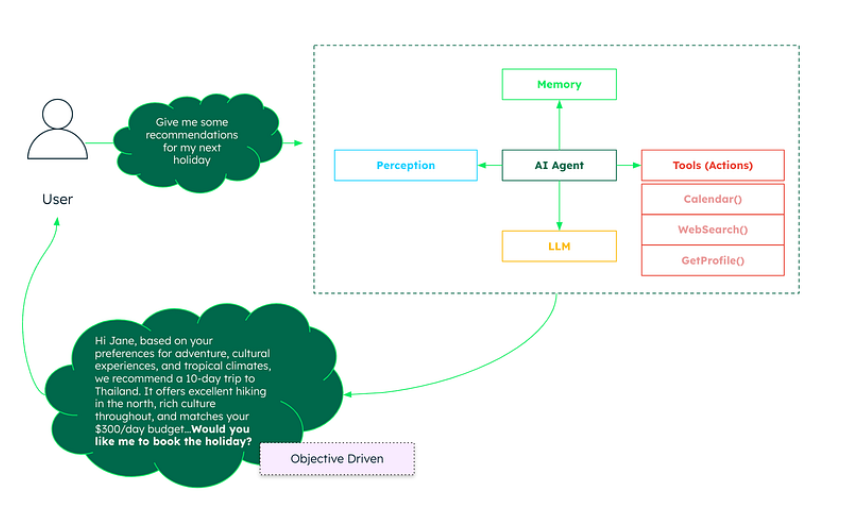

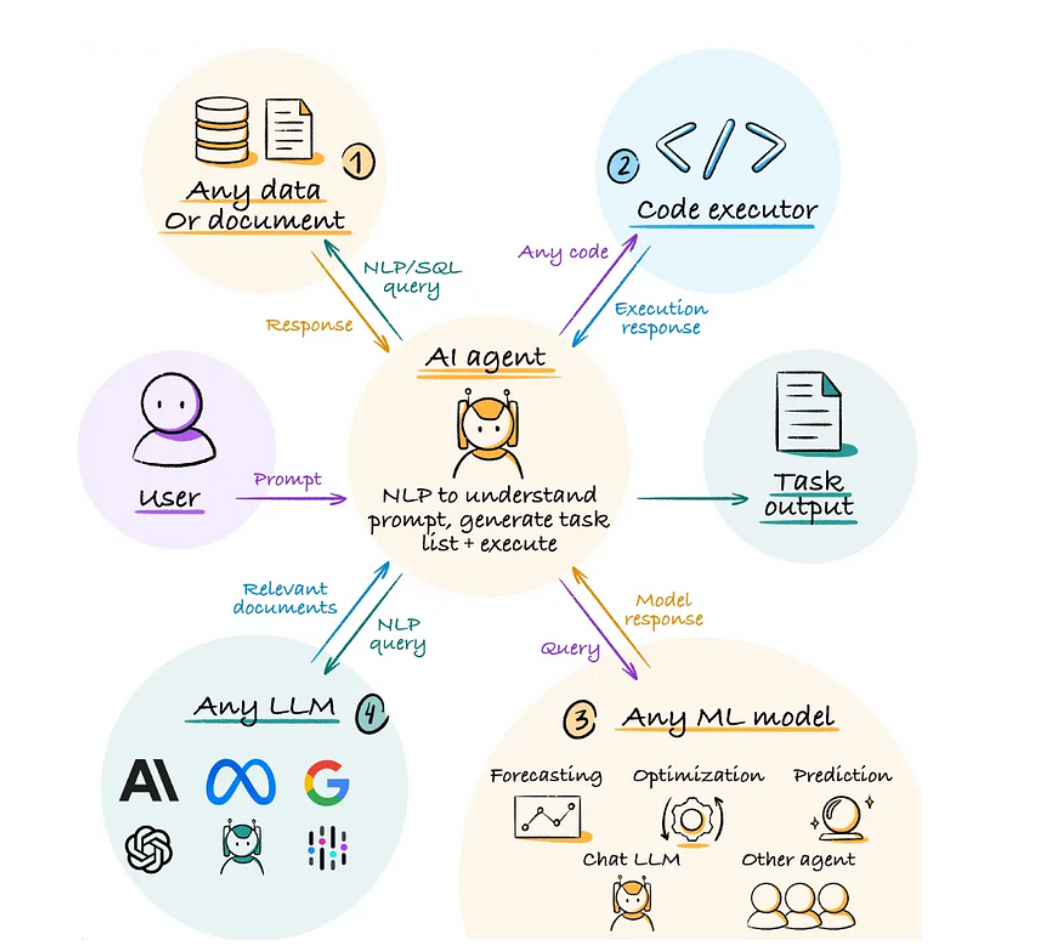

AI Agents并非简单升级版聊天机器人,而是基于大语言模型(LLMs)的深度进化,融合了工具调用(如API接口)、多步任务拆解(Multi-Step Planning)及因果推理(Reasoning Capabilities)三大核心能力,实现从“对话应答”到“自主决策”的范式革命。例如,它能自主调用数据分析工具生成报表、拆解复杂项目为可执行步骤,甚至模拟人类逻辑链推导商业决策——堪称数字时代的“超级执行官”。

Agentic RAG: 将 LLM 的推理、工具使用和规划能力与语义信息检索相结合。

使动态系统能够分解任务、执行复杂查询并利用工具解决问题。

从 LLM 驱动的聊天机器人向 RAG 聊天机器人和AI Agents的演进,代表着向更智能、更自适应、更工具集成的系统的转变,这些系统能够实时解决复杂的问题。

03

-

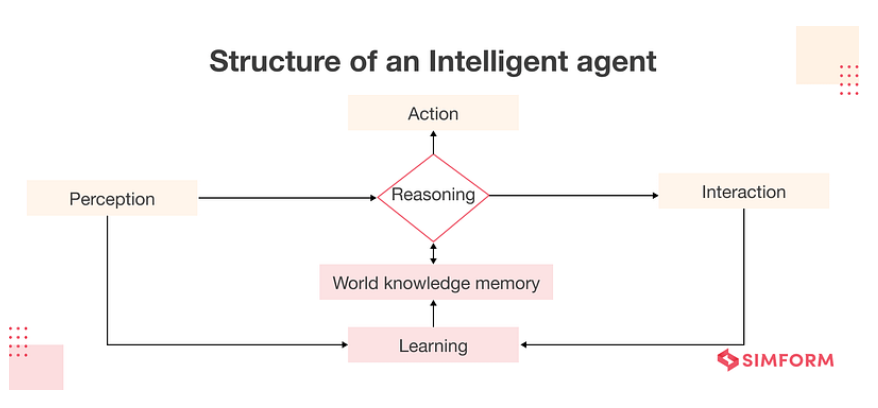

自主性:无需人工干预即可运行,独立做出决定。 -

反应式与主动式行为:既能应对环境变化,又能主动采取措施以确保目标实现。 -

适应性:通过处理新信息和新经验来学习和发展。 -

目标导向:努力实现预定目标或优化成果。 -

互动性:与其他代理或人类进行交流和合作。 -

持久性:持续运行,监控并应对动态环境。

04

-

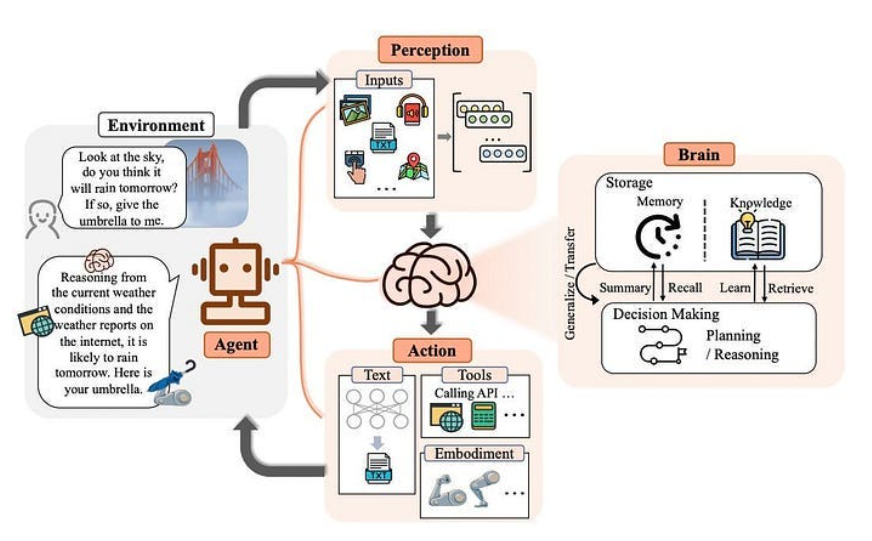

Perception (Sensors)

-

Reasoning (Processor)

- Action (Actuators)

- Knowledge Base

- Learning

- Communication Interface

-

感知阶段

-

决策阶段

-

行动阶段

-

适应性:如果出现意外情况,智能体可以在下一个感知阶段检测到,并相应调整行动。 -

学习机会:智能体可以将预测结果与实际结果进行比较,以改进未来的决策。 -

目标导向行为:每个循环都会使智能体更接近其目标,同时遵守约束条件。

06

AI 智能体与简单的自动化有何不同?

-

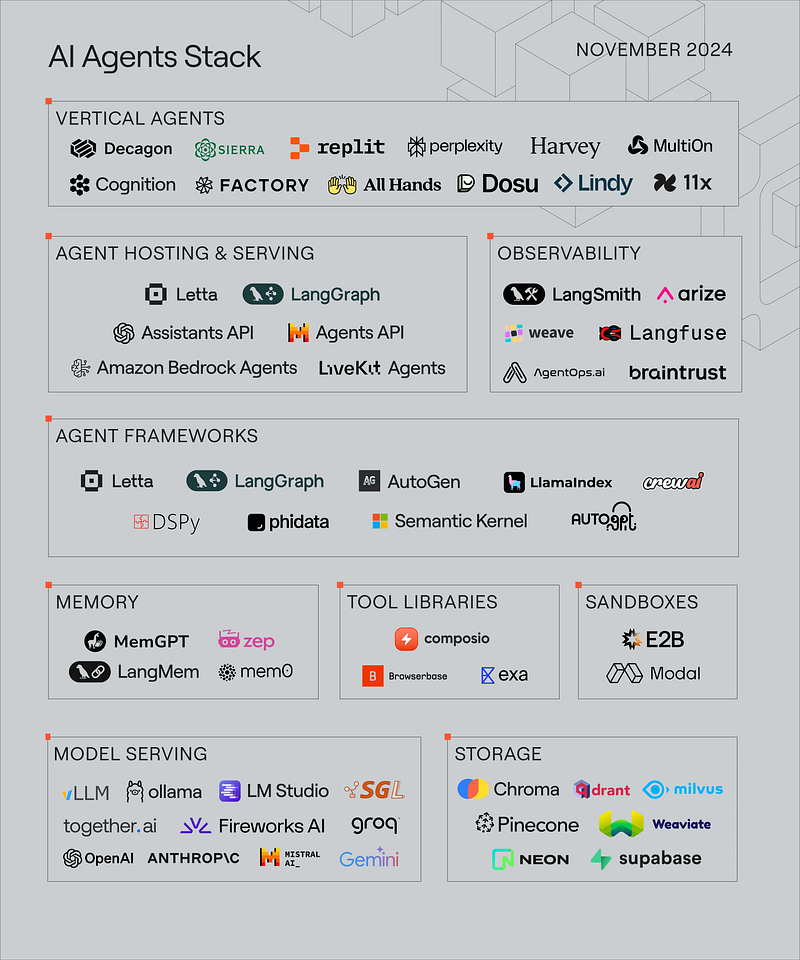

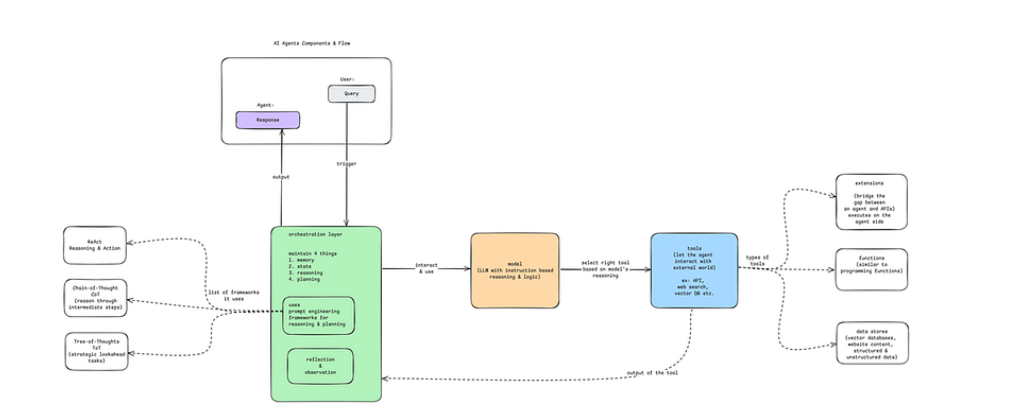

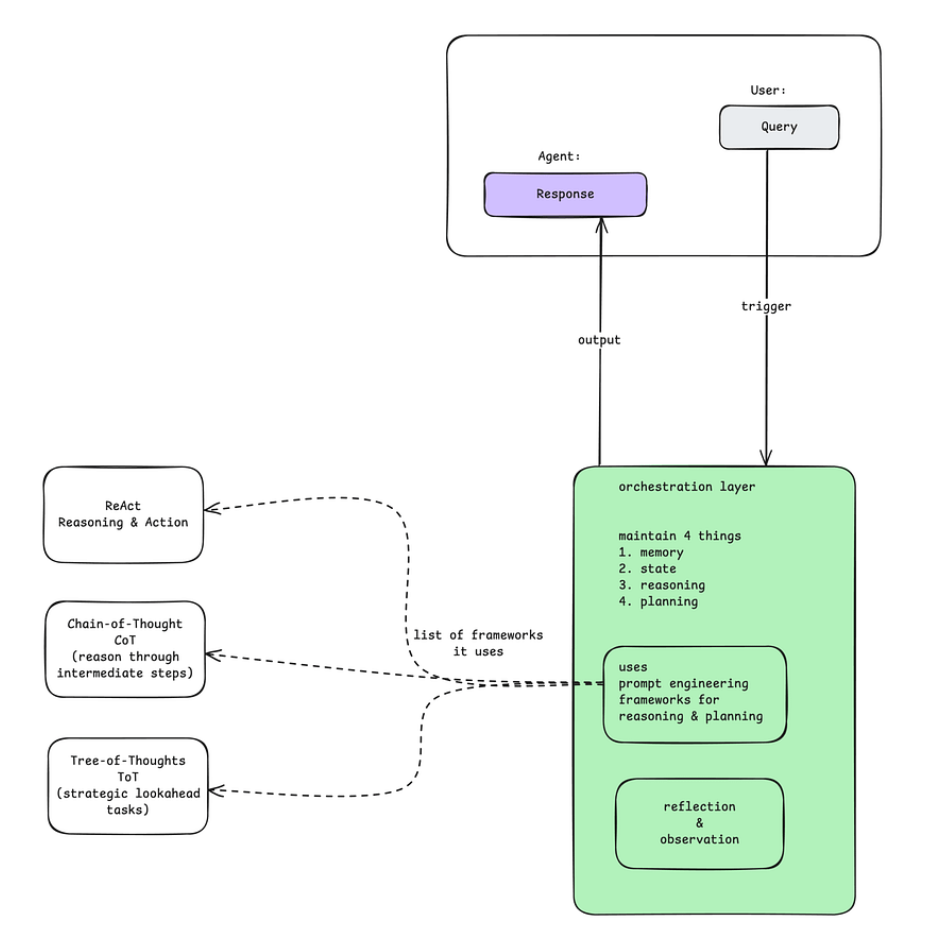

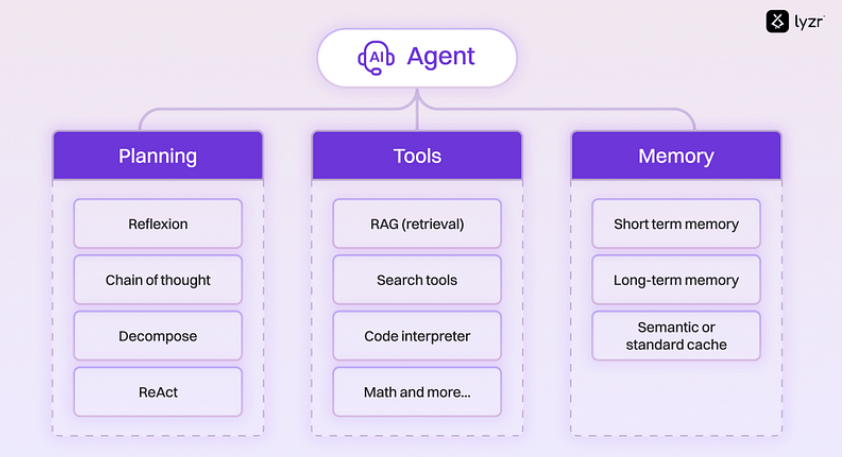

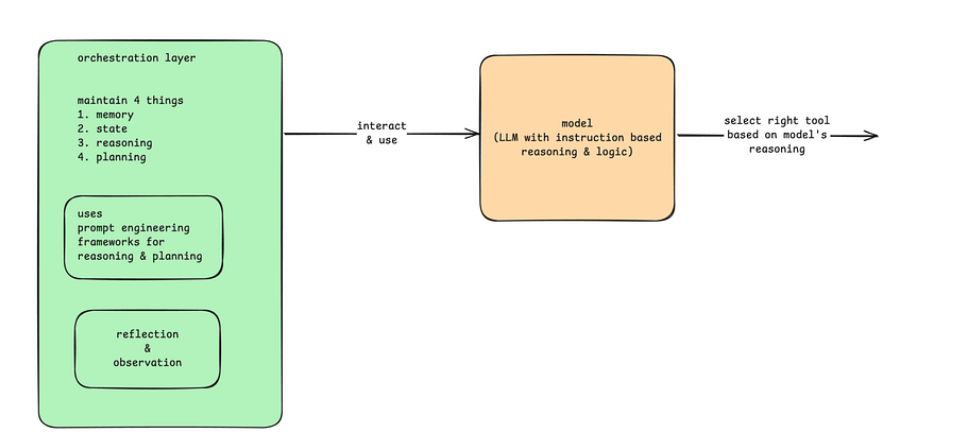

Orchestration layer (控制中心)

-

Memory: 保持整个互动过程的记忆。 -

State: 存储整个进程的当前状态。 -

Reasoning: 引导代理进行推理。 -

Planning: 步骤是什么,下一步是什么?

-

Models (大脑)

-

ReAct (Reason + Act) 确保采取深思熟虑的行动 -

Chain-of-Thought 通过中间步骤进行思维链推理。 -

思维树探索多种路径,找到最佳解决方案

-

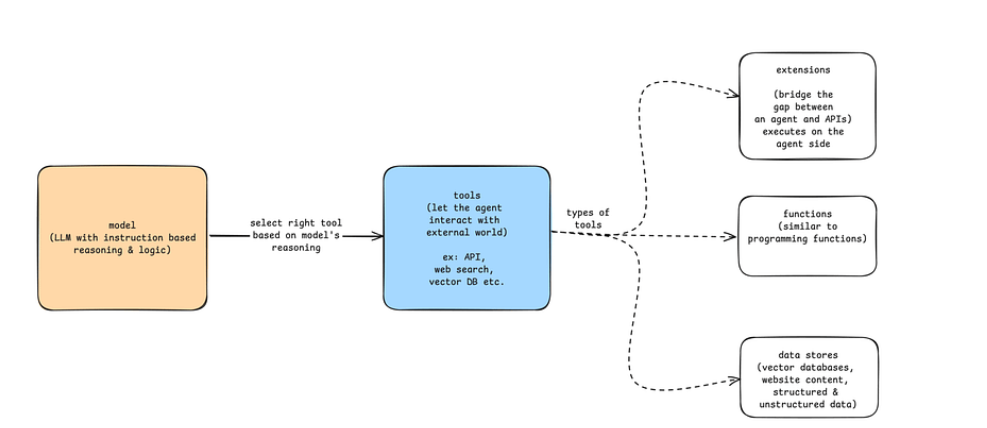

Tools (手)

-

想要了解有关旅行的知识吗?⇒ 让他们访问搜索栏,搜索相关的知识库 -

想与销售人员交谈?⇒ 给他们接入人工服务

如果预设的工作流程经常出现问题,这就意味着你需要更多的灵活性。这就是AI Agent的应用场景所在。

08

09

点击上方小卡片关注我

添加个人微信,进专属粉丝群!