1. 什么是MCP?

1. 什么是MCP?

Model Context Protocol(模型上下文协议)是一套为大型语言模型(LLM)设计的标准化上下文交互框架。它通过定义统一的数据格式规范、动态更新机制和权限控制体系,定义了应用程序和 AI 模型之间交换上下文信息的方式。这使得开发者能够以一致的方式将各种数据源、工具和功能连接到 AI 模型(一个中间协议层),就像 USB-C 协议能让不同设备能够通过相同的接口连接一样。MCP 的目标是创建一个通用标准,使 AI 应用程序的开发和集成变得更加简单和统一。

核心讲解:

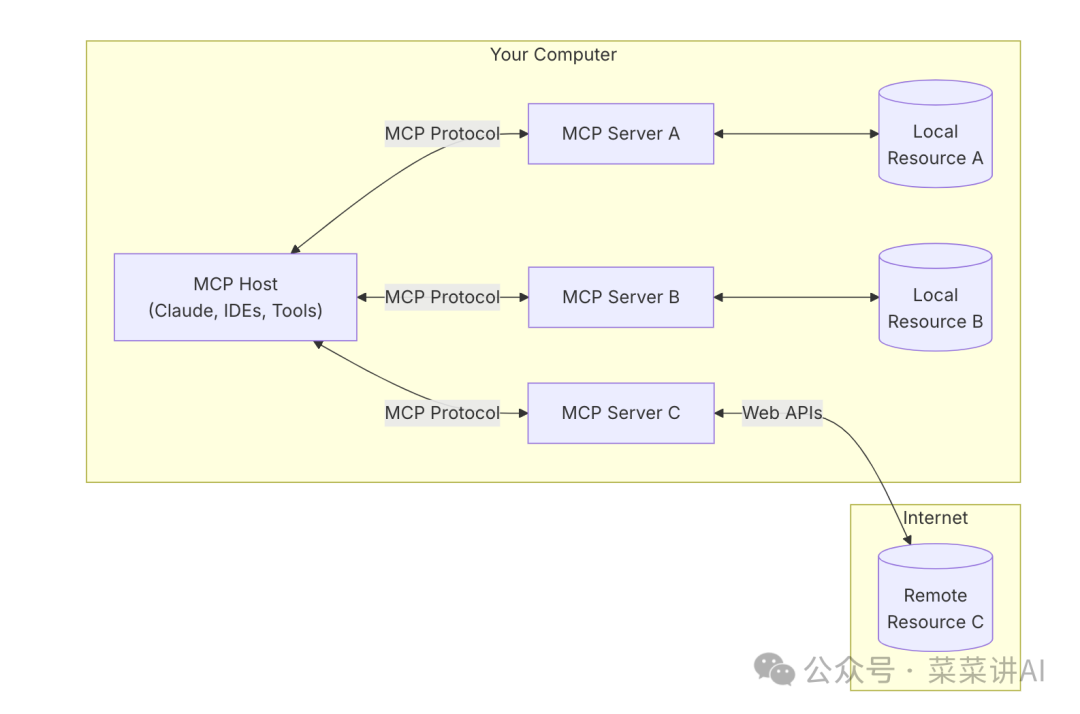

MCP 的核心是一个 client-server 架构,host 应用程序可以连接到多个服务器:

-

MCP Hosts: 像 Claude Desktop、IDEs 或 AI 工具这样的程序,它们希望通过 MCP 访问资源

-

MCP Clients: 维护与服务器 1:1 连接的协议客户端

-

MCP Servers: 轻量级程序,通过标准化的 Model Context Protocol 暴露特定功能

-

Local Resources: 你的计算机资源(数据库、文件、服务),MCP 服务器可以安全地访问这些资源

-

Remote Resources: 通过互联网可用的资源(例如,通过 APIs),MCP 服务器可以连接到这些资源

2. 为什么需要MCP?

2. 为什么需要MCP?

当前LLM应用面临三大核心痛点:

-

上下文碎片化:非结构化文本拼接导致信息丢失

-

格式不统一:不同系统使用自定义的上下文格式

-

动态更新困难:无法实时同步业务系统的最新状态

使用MCP带来的好处:

-

标准化数据格式:通过Schema定义上下文数据的字段、类型和语义

-

动态上下文同步:支持实时更新上下文状态(如用户偏好、实时数据)

-

细粒度权限管理:控制不同角色对上下文的访问和操作权限

-

跨模型兼容性:适配不同LLM架构的上下文输入需求

3. MCP的核心使用场景

3. MCP的核心使用场景

场景1:企业知识库集成

痛点:分散在Confluence、CRM、ERP等系统的知识难以有效利用

MCP方案:定义统一的知识Schema(FAQ/产品文档/案例库),建立自动同步机制

效果:模型响应准确率提升40%,知识更新延迟从小时级降至分钟级

场景2:个性化AI助手

痛点:用户画像、历史行为等动态数据难以有效组织

MCP方案:通过UserProfile Schema结构化存储用户特征,实时同步行为数据

效果:个性化推荐点击率提升25%,用户满意度提高32%

场景3:多模态数据处理

痛点:文本、图像、时序数据等异构信息难以协同

MCP方案:定义多模态上下文容器(MultimodalContext),支持混合数据类型输入

效果:复杂任务处理时间缩短50%,多模态理解准确度提升28%

4. MCP实战Demo:天气助手

4. MCP实战Demo:天气助手

让我们用 Python 构建您的第一个 MCP 服务器吧!我们将创建一个天气服务器,将当前天气数据作为资源提供,并允许 Claude 使用工具获取预报。 详细步骤可以参考官方文档,这里不做过多讲解。

https://mcp-docs.cn/docs/first-server/python

5. 写在最后:上下文交互的新范式

5. 写在最后:上下文交互的新范式

MCP的实践价值正在多个维度显现:

技术层面:统一了碎片化的上下文处理方案

工程层面:降低LLM集成的复杂度和维护成本

业务层面:释放了动态上下文数据的潜在价值

随着GPT-4、Claude 3等新一代模型对结构化上下文支持能力的增强,MCP正在成为LLM应用开发的事实标准。建议开发者重点关注以下方向:

-

构建企业级MCP上下文管理中心

-

探索上下文驱动的自适应推理机制

-

开发MCP-native的LLM应用框架

未来的智能系统将不再是简单的"提示工程",而是通过MCP实现业务系统-上下文引擎-LLM的三位一体协同,这标志着LLM应用开发正式进入工业化时代。

https://mcp-docs.cn/introduction