怎么让AI更好地连接我们的世界?

这是 AI 落地应用中令人十分常见又令人头疼的问题。「MCP(模型上下文协议)」正是为解决这一问题而生。

Manus 出圈以后带火了 MCP,江树这几天体验了以后发现真的很强!用上 MCP组合拳后直接让AI从只会bb到会干活,比如:一句话就能实现「批量抓取新闻热点并保存」!

昨儿还和几位朋友一起直播深入学习了 MCP,直播回放在「结构词AI」视频号:https://weixin.qq.com/sph/AojZibEfY

从 Claude 去年 11 月发布 MCP以来,MCP生态正在蓬勃发展,并且正在改变AI应用方式,孕育着新一轮巨大的机会。

今儿,我们一起聊聊 MCP 是什么?怎么用它来解锁未来的工作方式。

01 什么是MCP?

MCP:从USB-C到AI世界的标准接口。

你有没有想过,为什么现在几乎所有设备都用上了USB-C接口?

因为标准化带来便利。

在这之前,我们需要各种各样的线,手机一种,相机一种,笔记本又是一种。

现在呢?一根线走天下。

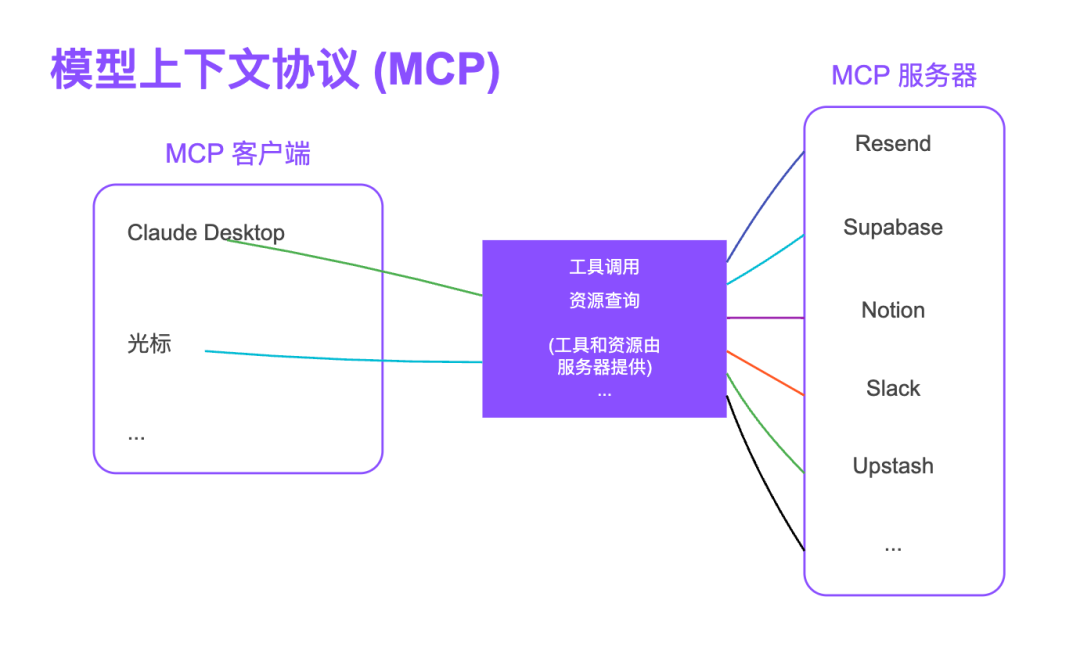

MCP就是AI世界的USB-C。它是一个开放协议,标准化了应用程序如何向大语言模型(LLM)提供上下文。

简单说,它让AI模型能够以统一的方式连接到不同的数据源和工具。

我们现在遇到的问题是什么?每个AI应用都在重复造轮子,都在想办法让模型连接到外部世界。而MCP的出现,就像当年USB标准的统一一样,一次解决,终身受益。

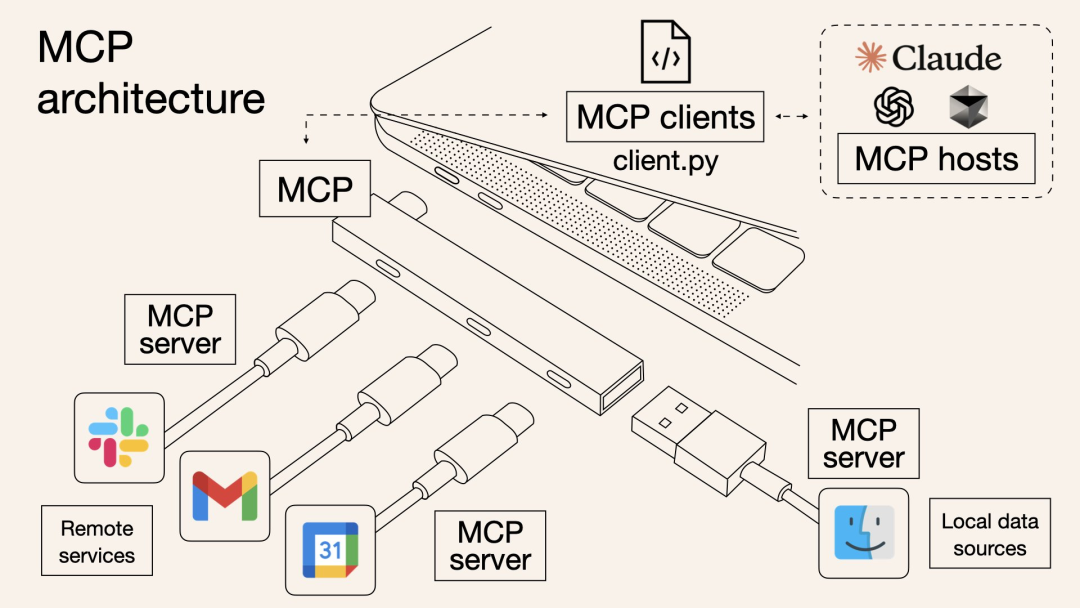

它的架构是这样的:

-

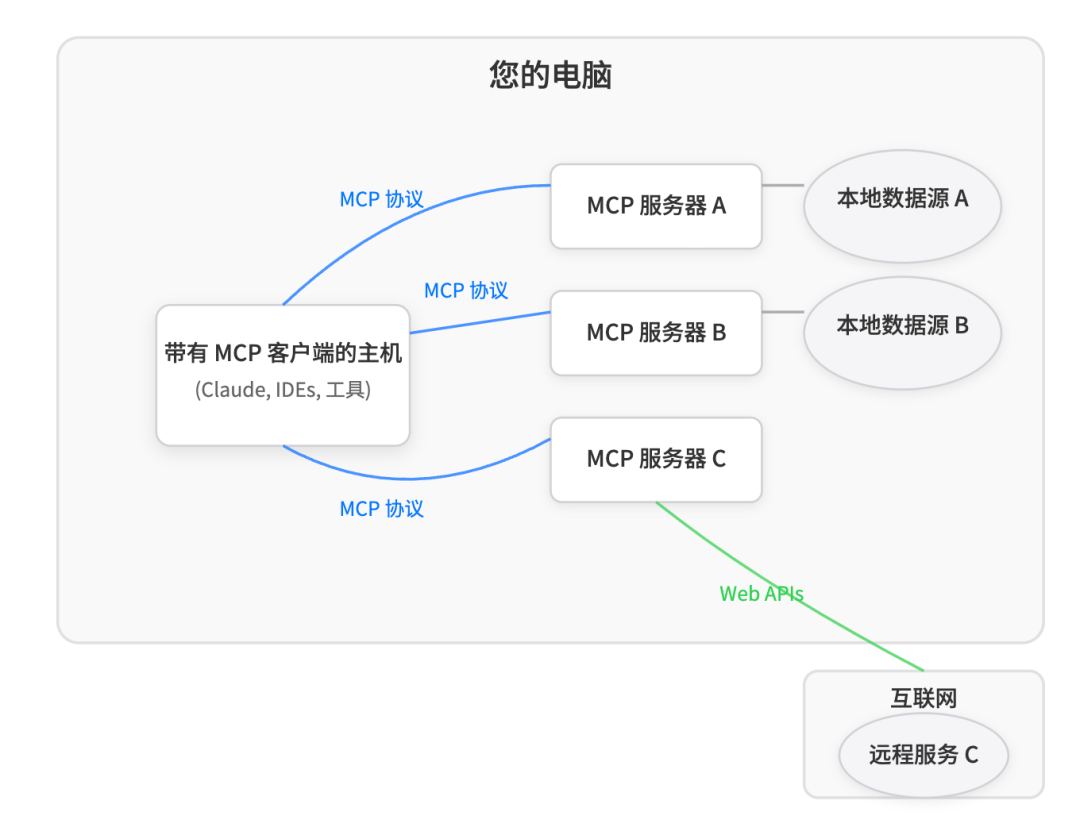

MCP Hosts: 像Claude桌面版、各种IDE或AI工具,它们想通过MCP访问数据 -

MCP Clients: 协议客户端,维持与服务器的1:1连接 -

MCP Servers: 轻量级程序,每个都通过标准化的模型上下文协议暴露特定功能 -

本地数据源: 你电脑上的文件、数据库和服务,MCP服务器可以安全访问 -

远程服务: 通过互联网可用的外部系统(如API),MCP服务器可以连接

看到这个架构,你可能会想,这不就是一个中间件吗?没错,但它的意义远不止于此。它建立了一套统一的语言,让AI和我们的数字世界能够无障碍对话。过去,每个AI应用都需要单独开发连接各种服务的接口,现在有了MCP,开发者只需遵循这一协议,就能让AI访问无数种服务和数据。

听起来复杂?其实本质很简单:MCP让AI能看懂你的世界,用你的工具。

示例:一键批量抓取新闻热点

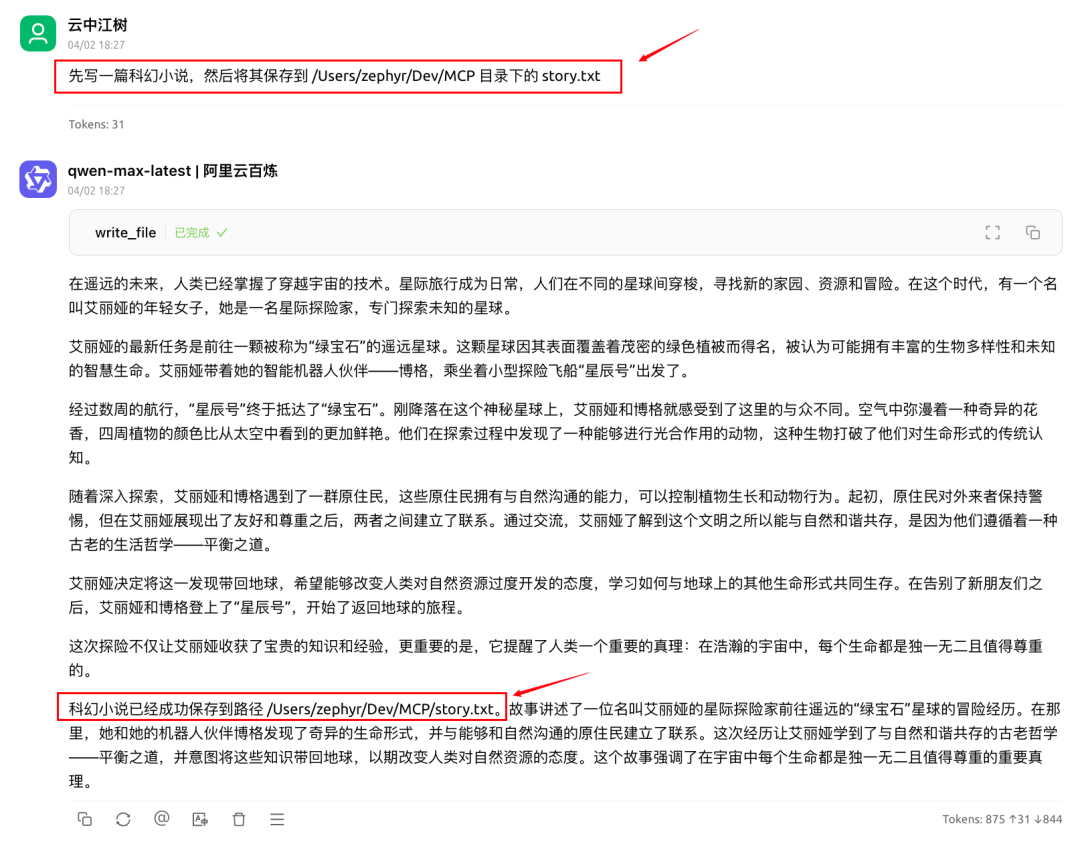

这里我们回顾一下江树前面的抓取新闻热点的例子,体会一下MCP带来的便利。

假设你想跟踪Anthropic公司的最新动态,传统方式需要你手动访问网站,找到新闻,一条条阅读并整理。

而有了MCP,你可以用一行简单的指令完成全部工作:

访问 https://www.anthropic.com/news 网站,获取最新的10条新闻(标题,中文总结,链接)的形式(csv),保存为文件(/Users/zephyr/Dev/MCP/temp/data.csv)

系统会立即执行这个指令 - 访问网站、提取新闻、翻译总结、生成CSV文件并保存到指定位置。整个过程自动化完成,无需你编写一行代码。

这看似简单的操作背后,是MCP协议实现的无缝连接:从网络访问,到内容分析,再到文件系统操作,AI通过MCP协议调用了多个不同的系统功能,就像你的大脑指挥手去完成一系列动作一样自然。

02 从单体智能到网络智能

要理解MCP的价值,我们需要先搞清楚当前AI生态中几个关键概念之间的关系。现在的AI世界正经历一场从"单体智能"到"网络智能"的变革,而MCP正是这场变革的关键推动力之一。

LLM(大语言模型):这是AI的"大脑",像Claude、GPT-4这样提供语言理解和生成能力的核心引擎。它们通过海量文本训练,获得了强大的语言理解和生成能力,但仅凭自身,它们无法"看见"或"操作"外部世界。

Agents(智能代理):这是LLM的"进化版",不仅能思考,还能执行任务。**可以理解为给LLM装上了"手脚"**。通过Agent技术,AI不再只是被动回应,而是能主动规划和完成复杂任务。

Function Calling:这是OpenAI给LLM加的"小工具箱",让GPT能调用预定义的函数。这是一种专有技术,虽然强大,但只能在支持的模型生态内使用,且功能相对有限。

MCP(模型上下文协议):这是Anthropic推出的"万能插头",让AI能连接外部世界的各种数据和工具。关键是它是开源的,不绑定特定厂商。这意味着任何AI模型、任何开发者都能基于MCP构建连接能力。

ANP(智能体网络协议):这是为LLM和Agents设计的"通信协议",让不同的AI智能体能互联互通,协同工作。如果说MCP解决了"AI与工具"的连接问题,ANP则解决了"AI与AI"的协作问题。

举个例子:从家庭智能管家看懂这些关系

想象你家有个超级智能的管家(这就是LLM):

-

Function Calling给了它一个遥控器,可以控制家里的电视机(但只能控制特定品牌) -

MCP给它接上了智能家居中枢,能控制全屋所有设备,不管什么品牌 -

ANP则让它能和邻居家的管家"打电话",一起协调更复杂的任务

MCP专注于"AI与工具"的连接,ANP则专注于"AI与AI"的连接。前者让单个AI更强大,后者让多个AI能协作。这两个协议共同定义了未来AI应用的基础架构。

为什么这很重要?因为未来的AI不是孤岛,而是生态网络。就像互联网不是一台电脑,而是无数台电脑的连接一样,AI的价值将在连接中爆发性增长。

03 实战:在Cherry Studio上使用MCP

咱们聊了这么多理论,你肯定跃跃欲试,想亲自感受一下MCP的魅力。不过先打个预防针 - MCP生态虽然发展迅猛,但目前的用户体验还不够成熟。如果你没有开发背景,可能会遇到一些技术门槛(遇到问题别着急,这是新技术的必经之路)。

好消息是,已经有先行者为我们铺平了部分道路。Cherry Studio作为支持MCP的开源工具,为我们提供了一个相对友好的入口。下面我们就来看看这个"AI连接器"的实际操作。

官方教程:https://docs.cherry-ai.com/advanced-basic/mcp

提醒:请全程魔法上网~

3.1 基础环境搭建

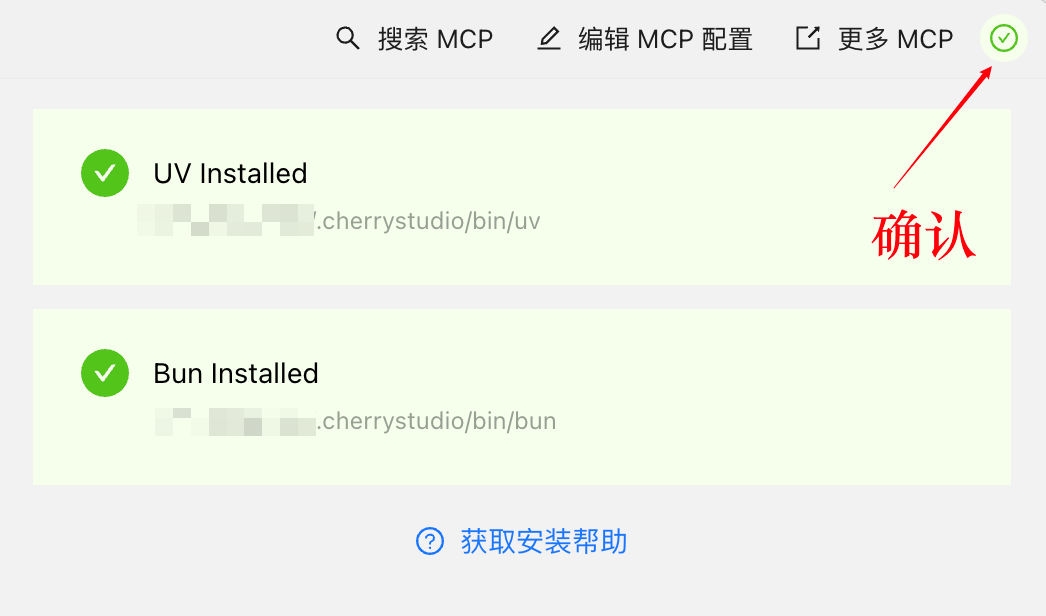

首先,Cherry Studio使用MCP需要两个核心组件:uv和bun。它们就像MCP世界的"发动机"和"变速箱",缺一不可。

-

打开Cherry Studio的设置界面,找到"MCP服务器"选项 -

点击"安装"按钮,系统会从GitHub自动下载这两个组件

这里有个关键细节:Cherry Studio使用的是自己的uv和bun版本,即使你电脑上已经安装了这两个工具,它也不会调用。安装过程可能会慢一些,因为要从GitHub下载资源,需要一点耐心。

安装成功的标志很直观 - 右上角会显示一个绿色的√。没看到这个标志,就意味着配置还没完成,可能需要重启一下电脑再试试。

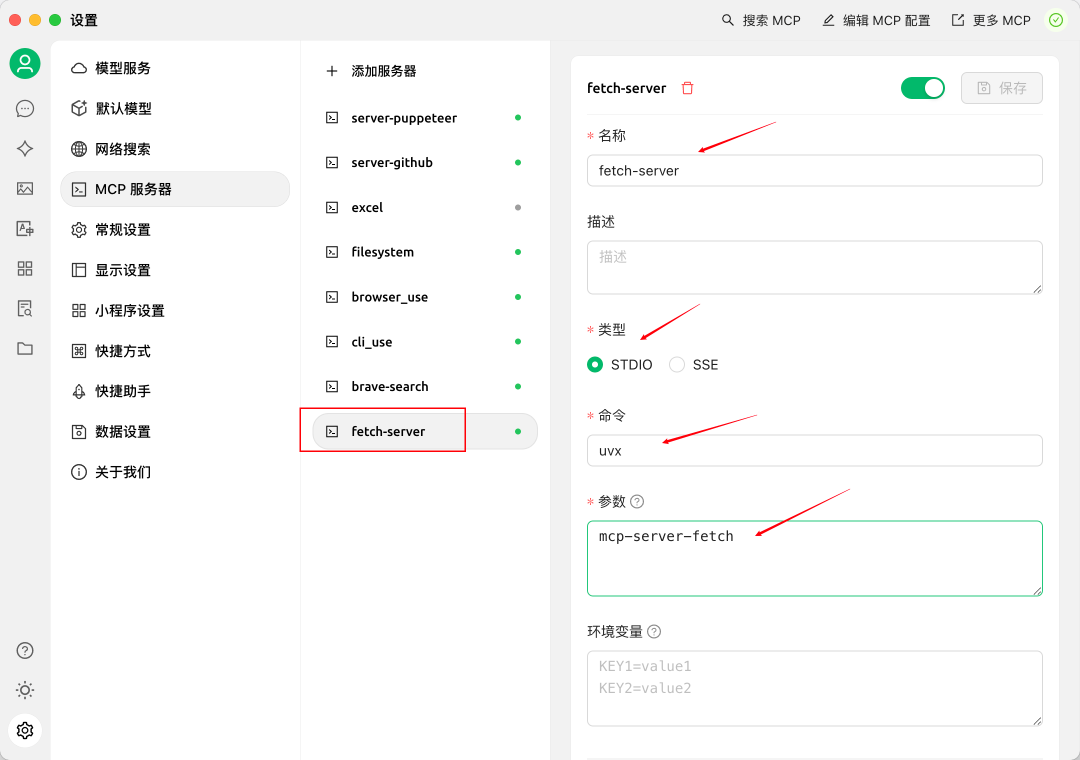

3.2 MCP服务器配置

环境准备好后,我们需要告诉系统:希望AI拥有什么能力。这就是配置MCP服务器的过程:

-

在设置中找到"MCP服务器"选项 -

点击"添加服务器" -

填入这些关键信息:

-

名称:自定义一个名称,比如 fetch-server(相当于给这个能力起个名字) -

类型:选择 STDIO(这是通信方式) -

命令:填写 uvx(工具名称) -

参数:填写 mcp-server-fetch(具体功能) -

点击"确定"保存 -

使用支持函数调用的模型(识别方法:模型名称后有扳手图标) -

确保MCP服务器配置成功 -

过去:像使用工具一样使用AI,每次打开特定应用 -

未来:AI像电力般无处不在,自然融入每个工作流

完成这一步后,Cherry Studio会自动下载所需的MCP Server,这相当于给AI装上了"上网能力"。

3.3 实际使用体验

要让AI发挥MCP的威力,还需要满足两个条件:

模型选择很关键,国内的通义千问就能用,不必局限于Claude。只要支持函数调用的模型都可以,推荐顺序是:Claude > Qwen2.5-Max > DeepSeek。如果你想用阿里的Qwen2.5-Max,直接去阿里云官网配置即可。

一切就绪后,聊天界面会出现启用MCP服务的按钮,点击后你就进入了AI能力的新境界。

从实际效果看,AI通过MCP获得了"连接现实世界"的能力 - 它能实时抓取网络信息,告诉你当下正在发生的事情。这不是简单的功能叠加,而是能力性质的跃升 - AI不再是"记忆者",而成为了"探索者"。

如果说过去的AI像一个博学但与世隔绝的学者,那么有了MCP,它就成了一个既有知识积累又能实时探索世界的全能助手。这才是真正的智能体验。

04 最后

MCP协议代表了AI世界的根本转变:从封闭到开放,从孤岛到连接。它将彻底改变我们与AI的互动方式:

这是从"AI即服务"到"AI即基础设施"的跨越。

未来已来,只是分布不均。成为那个提前拥抱未来的人。